Eine Reihe von Unternehmen, darunter Microsoft і Facebook, und sogar Forscher der University of Southern California, entwickeln Technologien, um Deepfakes zu bekämpfen und ihre Verbreitung durch gelbe Medien und Fehlinformationen im Allgemeinen zu verhindern. Einer Gruppe von Wissenschaftlern gelang es jedoch, sie zu täuschen.

Ein Team von Informatikern der University of California, San Diego, warnte davor, dass es immer noch möglich ist, bestehende Deepfake-Erkennungssysteme zu täuschen, indem Eingabedaten, die als „konkurrierende Beispiele“ bezeichnet werden, in jeden Videoframe eingefügt werden. Die Wissenschaftler stellten ihre Ergebnisse auf der WACV 2021 Computer Vision Conference vor, die letzten Monat online stattfand.

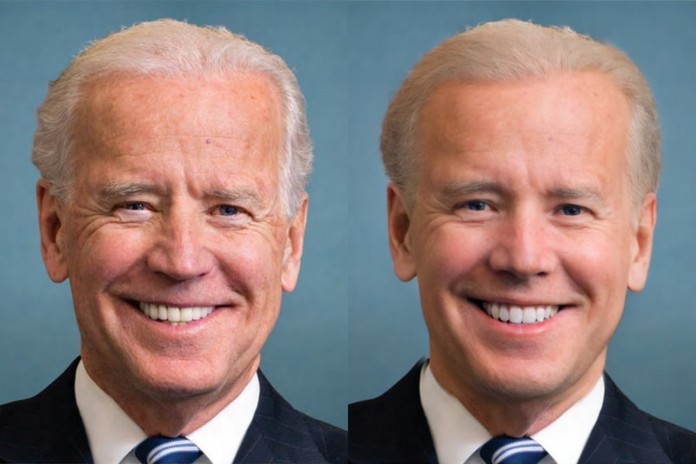

Konkurrierende Beispiele sind leicht veränderte Eingaben, die dazu führen, dass Systeme der künstlichen Intelligenz, wie z. B. Modelle für maschinelles Lernen, Fehler machen. Darüber hinaus zeigte das Team, dass der Angriff nach dem Komprimieren des Videos immer noch funktioniert. Im obigen Video zeigen die Wissenschaftler, dass XceptionNet, ein Deepfake-Detektor, ihr konkurrierendes Video als „echt“ bezeichnet.

Die meisten dieser Detektoren arbeiten, indem sie Gesichter in einem Video verfolgen und die zugeschnittenen Gesichtsdaten zur Analyse an ein neuronales Netzwerk senden. Das neuronale Netz analysiert dann diese Daten und findet Elemente, die in Deepfakes normalerweise schlecht wiedergegeben werden, wie beispielsweise das Flackern.

Durch das Einfügen konkurrierender Beispiele stellten die Forscher fest, dass sie diese Deepfake-Detektoren glauben machen konnten, dass die Videos echt seien.

Sie stellen in dem Papier fest, dass „um diese Deepfake-Detektoren in der Praxis einzusetzen, es wichtig ist, sie gegen einen adaptiven Gegner zu evaluieren, der sich dieses Schutzes bewusst ist und bewusst versucht, ihn zu brechen. Wir zeigen, dass moderne Deepfake-Erkennungsmethoden leicht umgangen werden können, wenn der Angreifer den Detektor ganz oder teilweise kennt."

Wie diese Wissenschaftler gezeigt haben, sind die Automatisierungstechnologien, die zur Bekämpfung von Desinformation entwickelt werden, dieser Aufgabe möglicherweise noch nicht gewachsen.

Lesen Sie auch: